Costruirò e ottimizzerò le tue pipeline di dati

Trasformare i dati in insight e le idee in soluzioni web potenti

Informazioni su questo servizio

Stai cercando un esperto di data engineering di alto livello per trasformare le tue sfide con i big data in soluzioni fluide e scalabili?

Benvenuto! Sono Nitin, un Big Data Engineer con oltre 3 anni di esperienza e una profonda conoscenza delle tecnologie di data engineering moderne.

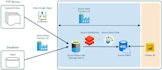

Sono specializzato nella creazione di pipeline di dati robuste, affidabili ed efficienti usando Databricks, Apache Spark, Apache Airflow, Azure Data Factory (ADF) e architetture event-driven con Kafka. Che tu abbia bisogno di workflow classici ETL/ELT, soluzioni avanzate di data warehousing o architetture Lakehouse all'avanguardia con Delta Lake, sono qui per te.

Cosa offro:

- Progettazione e sviluppo di pipeline ETL/ELT ad alte prestazioni per ambienti dati complessi

- Soluzioni di data warehousing, inclusa la progettazione di schema, modellazione dei dati e ottimizzazione

- Implementazione di streaming di dati in tempo reale usando Kafka

- Orchestrazione automatizzata dei workflow con Apache Airflow per affidabilità e scalabilità

- Competenza in PySpark e SQL per trasformazioni e analisi di grandi volumi di dati

- Pipeline Azure Data Factory con workflow dinamici e monitoraggio

- Gestione di data lake e delta lake per garantire accesso ai dati preciso, coerente e veloce.

Collaboriamo per sbloccare il vero valore dei tuoi dati

Il mio portfolio

FAQ

Traduzione automatica.

Fornite supporto dopo il progetto?

Sì, offro supporto post-progetto e risoluzione dei problemi per garantire un funzionamento senza intoppi.

Quali sono i tempi di consegna?

Il tempo di consegna dipende dalla complessità del progetto, ma mi impegno sempre a consegnare lavori di qualità nel minor tempo possibile e a mantenere una comunicazione chiara.

Puoi aiutare con l'ottimizzazione delle prestazioni?

Assolutamente! Analizzo e ottimizzo i tuoi workflow di dati esistenti per garantire le massime prestazioni e i minimi costi.

In quali tecnologie siete specializzati?

Databricks, Apache Spark, Apache Airflow, Azure Data Factory, Kafka, MQTT, Delta Lake, PySpark, SQL e data warehousing moderni.

Che tipo di progetti puoi gestire?

Dalla creazione di pipeline ETL/ELT scalabili alla gestione di dati in streaming in tempo reale e alla progettazione di architetture di data warehouse, gestisco progetti di tutte le dimensioni — da startup a sistemi di livello enterprise.